-

Qwen2-VL – 阿里巴巴达摩院开源的视觉多模态AI模型

Qwen2-VL项目简介 Qwen2-VL是阿里巴巴达摩院开源的视觉多模态AI模型,具备高级图像和视频理解能力。Qwen2-VL支持多种语言,能处理不同分辨率和长宽比的图片,实时分析动态视频内容。Qwen2-VL在多语言文本理解、文档理解等任务上表现卓越,适用于多模态应用开发,推动了AI在视觉理解和内容生成领域的进步。 Qwen2-VL优势介绍 图像理解:显著提高模型理解和解释视觉信息的能力,为图…- 1

- 0

-

Cradle – 通用计算机控制的多模态AI Agent框架

Cradle项目简介 Cradle是面向通用计算机控制(General Computer Control, GCC)的多模态AI Agent框架,由昆仑万维携手北京智源人工智能研究院、新加坡南洋理工大学、北京大学等顶尖名校机构推出的通用计算机控制框架,使AI Agent无需训练便能像人一样直接控制键盘鼠标,不依赖任何内部API,实现任意开闭源软件交互。 Cradle是迄今为止第一个既能玩多种商业游…- 2

- 0

-

多模态AI席卷网络,DeepMind Veo 3与GPT-4o引领增长新引擎

近年来,多模态AI技术以其强大的跨领域能力,逐渐成为科技行业的增长引擎。谷歌DeepMind最新发布的Veo3模型以及OpenAI的GPT-4o,通过结合文本、图像、视频甚至音频的生成能力,不仅提升了用户体验,还在全球范围内引发了广泛关注和流量激增。以下,AIbase将为您梳理来自网络的最新信息,深入剖析多模态AI如何推动技术与商业的双重突破。 DeepMind Veo3:视频生成新标杆,流量增长…- 3

- 0

-

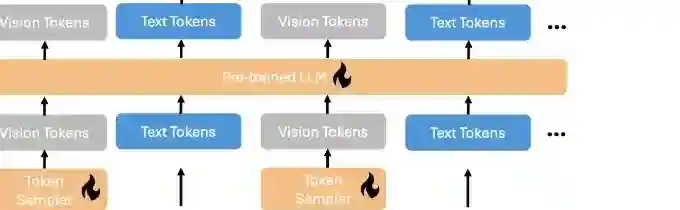

xGen-MM – Salesforce推出的开源多模态AI模型

xGen-MM项目简介 xGen-MM是Salesforce推出的一款开源多模态AI模型,具有处理交错数据的能力,能同时理解和生成文本、图像等多种数据类型。xGen-MM通过学习大量的图片和文字信息,不仅在视觉语言任务上展现出强大的性能,还通过开源模型、数据集和微调代码库,促进模型能力的不断提升。 xGen-MM优势介绍 多模态理解:xGen-MM能同时处理和理解图像和文本信息,支持回答关于视觉内…- 5

- 0

-

Ichigo – 开源的多模态AI语音助手,实时处理语音和文本的交织序列

Ichigo项目简介 Ichigo是开源的多模态AI语音助手,采用混合模态模型,能实时处理语音和文本的交织序列。基于将语音直接量化为离散令牌,用统一的变换器架构同时处理语音和文本,实现跨模态的联合推理和生成。基于此方法提高了处理速度,降低算力消耗,让首令牌生成的延迟仅为111毫秒,远低于现有模型,让Ichigo能提供接近实时的语音交互体验。 Ichigod主要功能 实时语音处理:Ichigo实时处…- 1

- 0

-

Pixtral 12B – Mistral AI推出的首款多模态AI模型

Pixtral 12B项目简介 Pixtral 12B 是法国AI初创公司Mistral推出的首款多模态AI模型,能同时处理图像和文本。模型拥有 120 亿参数,模型大小约为 24GB,基于文本模型 Nemo 12B构建,能回答任意数量、任意尺寸图像的问题。Pixtral 12B 能执行为图像添加描述、统计照片中物体数量等任务。用户可以下载、微调 Pixtral 12B 模型,依据 Apache …- 2

- 0

-

ImageBind – Meta推出开源多模态AI模型,实现六种多模态数据整合

ImageBind项目简介 ImageBind是Meta公司推出的开源多模态AI模型,将文本、音频、视觉、温度和运动数据等六种不同类型的信息整合到一个统一的嵌入空间中。模型通过图像模态作为桥梁,实现其他模态数据的隐式对齐,无需直接的模态间配对数据。ImageBind在跨模态检索、零样本分类等任务中展现出色的性能,为创建沉浸式、多感官的AI体验提供新的可能性。 ImageBind优势介绍 多模态数据…- 2

- 0

-

NEXUS-O – 多模态AI模型,实现对语言、音频和视觉全方位感知与交互

NEXUS-O项目简介 NEXUS-O 是HiThink 研究院、英国帝国理工学院、浙江大学、复旦大学、微软、Meta AI等机构推出的多模态AI模型,能实现对语言、音频和视觉信息的全方位感知与交互。NEXUS-O能处理音频、图像、视频和文本的任意组合输入,用音频或文本形式输出结果。NEXUS-O 基于视觉语言模型预训练,用高质量合成音频数据提升三模态对齐能力。NEXUS-O引入新的音频测试平台 …- 3

- 0

-

华知大模型5.0 – 知网联合华为云推出的多模态AI大模型

华知大模型5.0项目简介 华知大模型5.0是同方知网与华为云联合推出的AI大模型,具备多模态理解和生成能力。华知大模型5.0的最大亮点在于多维模型的构建能力,涵盖从7B到135B不等的多种规模模型。通过跨模态多层语义融合技术,处理学术图片、统计表格等数据,实现复杂场景下的智能识别和分割。模型采用多级思维链增强技术,提升内容生成的逻辑性和可信度,有效抑制大模型幻觉问题。 华知大模型5.0优势介绍 A…- 3

- 0

-

Amazon Nova Premier – 亚马逊推出的多模态AI模型

Amazon Nova Premier项目简介 Amazon Nova Premier 是亚马逊推出功能最强大的多模态 AI 模型,能处理文本、图像和视频输入(不包括音频),擅长处理需要深度理解上下文、多步骤规划以及跨多工具和数据源精确执行的复杂任务。支持高达100万token的上下文长度,可处理超长文档或大型代码库。 Nova Premier 可作为教师模型,通过 Amazon Bedrock …- 0

- 0

-

山海大模型 – 云知声推出的多模态AI大模型

山海大模型项目简介 山海大模型是云知声推出的多模态AI大模型,具备丰富的知识储备和多模态交互能力。山海大模型能通过文本、音频、图像等多种形式与用户进行实时互动,提供信息查询、知识学习、灵感激发等服务。山海大模型特点包括实时响应、情绪感知、音色切换和视觉场景理解,最新推出的山海多模态大模型,能实现实时的多模态交互,实时生成文本、音频和图像。 山海大模型优势介绍 内容生成与理解:能生成流畅的文本并理解…- 0

- 0

-

GLM-4V-Plus – 智谱AI最新推出的多模态AI模型,专注图像和视频理解

GLM-4V-Plus项目简介 GLM-4V-Plus是智谱AI最新推出的多模态AI模型,专注于图像和视频理解。GLM-4V-Plus不仅能够精确分析静态图像,还具备动态视频内容的时间感知和理解能力,能捕捉视频中的关键事件和动作。作为国内首个提供视频理解API的模型,GLM-4V-Plus已集成在“智谱清言APP”中,并上线“视频通话”功能。同时,GLM-4V-Plus在智谱AI开放平台 BigM…- 3

- 0

-

Gemini 2.5 Pro (I/O 版) – 谷歌推出的升级版多模态AI模型

Gemini 2.5 Pro (I/O 版)项目简介 Gemini 2.5 Pro (I/O 版) 是 Google 推出的 Gemini 2.5 Pro 升级版多模态AI模型,具体版本号为 Gemini 2.5 Pro Preview 05-06。模型在编程能力上取得重大突破,擅长构建交互式 Web 应用、游戏和模拟程序。用户仅需提供提示词或手绘草图加功能描述,能快速生成功能完备的应用。Gemi…- 2

- 0

-

NVIDIA放大招!Llama-Nemotron-Nano-VL-8B-V1发布,图像视频文本全能,微调王座谁与争锋?

人工智能领域的竞争日趋白热化,NVIDIA再次以其强大的技术实力引领潮流。AIbase从社交媒体平台获悉,NVIDIA最新发布了Llama-3.1-Nemotron-Nano-VL-8B-V1,一款支持图像、视频和文本输入的视觉到文本模型,输出高质量文本并具备图像推理能力。这一模型的发布不仅展示了NVIDIA在多模态AI领域的雄心,也为开发者提供了高效的轻量化解决方案。本文将为您详细解析这款模型的…- 2

- 0