-

万相首尾帧模型 – 阿里通义开源的首尾帧生视频模型

万相首尾帧模型项目简介 万相首尾帧模型(Wan2.1-FLF2V-14B)是开源的14B参数规模的首尾帧生视频模型。模型根据用户提供的首帧和尾帧图像,自动生成流畅的高清视频过渡效果,支持多种风格和特效变换。万相首尾帧模型基于先进的DiT架构,结合高效的视频压缩VAE模型和交叉注意力机制,确保生成视频在时空上高度一致。用户可在通义万相官网免费体验。 万相首尾帧模型优势介绍 首尾帧生视频:根据用户提供…- 0

- 0

-

HuggingFace 推出小型智能机器人,五小时销售额超百万,299 美元起购

近日,知名 AI 平台 HuggingFace 进军智能机器人领域,推出了开源桌面机器人 Reachy Mini,迅速引发热潮。这个小巧的机器人在短短五个小时内就实现了超过13万欧元(约合人民币109万元)的销售额,令人惊叹。对于299美元的有线版 Reachy Mini Lite 和499美元的无线版 Reachy Mini,消费者纷纷表示迫不及待想要下单,价格甚至可以说是与一块 Apple W…- 0

- 0

-

Instella – AMD开源的30亿参数系列语言模型

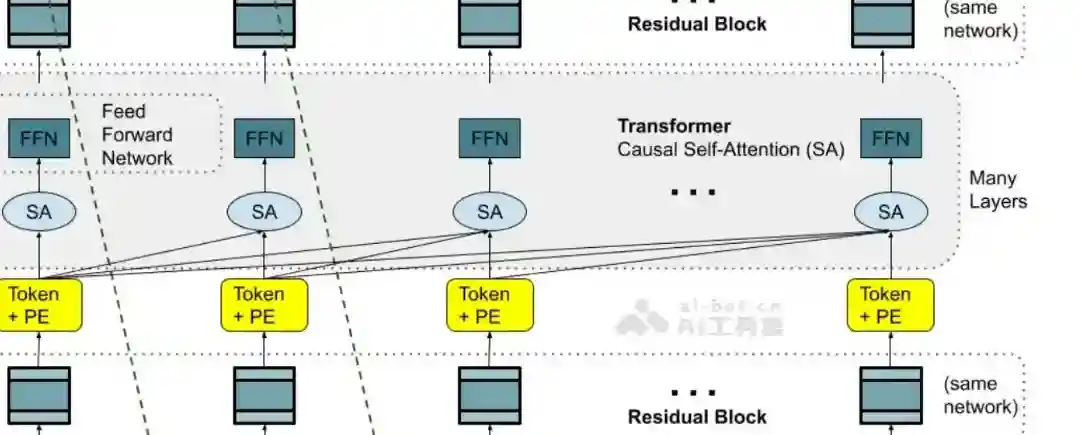

Instella项目简介 Instella是AMD推出的系列30亿参数的开源语言模型。模型完全从零开始在AMD Instinct™ MI300X GPU上训练而成,基于自回归Transformer架构,包含36个解码器层和32个注意力头,支持最长4096个标记的序列。Instella经过多阶段训练,包括大规模预训练、监督微调和偏好优化,提升自然语言理解、指令跟随和对话能力。Instella在多个基…- 0

- 0

-

DrivingDojo – 中科院联合美团推出的交互式驾驶世界模型数据集

DrivingDojo项目简介 DrivingDojo是中国科学院自动化研究所与美团无人车团队合作推出的数据集,用在训练和研究复杂的自动驾驶交互式世界模型。数据集包含18,000个视频片段,覆盖完整的驾驶操作、多智能体交互以及丰富的开放世界驾驶知识,为开发下一代自动驾驶模型提供了坚实的基础。DrivingDojo定义了动作指令跟随(AIF)基准,用在评估世界模型在执行动作控制的未来预测方面的能力。…- 1

- 0

-

Zamba2-7B – Zyphra推出的小型语言模型

Zamba2-7B项目简介 Zamba2-7B是Zyphra公司推出的小型语言模型,基于创新的架构在保持输出质量的同时实现快速的推理速度和低内存占用。模型在处理图像描述等任务时表现出色,适合在边缘设备和消费级GPU上运行。Zamba2-7B采用Mamba2块替代Mamba1块,引入两个共享注意力块用ABAB模式排列,在MLP模块上应用LoRA投影器提高性能。Zamba2-7B在小模型中领先,在质量…- 0

- 0

-

Hugging Face进军人形机器人市场:推出售价3000美元的开源机器人HopeJR

人工智能开发平台Hugging Face周四正式进军机器人硬件领域,发布了两款开源人形机器人产品,旨在打破大型科技公司对机器人技术的垄断。 两款新品各有特色 该公司推出的两款机器人分别针对不同应用场景:HopeJR是一款全尺寸人形机器人,配备66个驱动自由度,具备完整的行走和手臂操作能力;Reachy Mini则是一款桌面级机器人,专注于头部运动、语音交互和AI应用测试。 在定价方面,HopeJR…- 3

- 0

-

OLMo 2 32B – Ai2 推出的最新开源语言模型

OLMo 2 32B项目简介 OLMo 2 32B 是 Allen Institute for AI(Ai2)推出的最新开源语言模型,是 OLMo 2 系列的重要成果。拥有 320 亿参数,是首个在多技能学术基准测试中超越 GPT-3.5-Turbo 和 GPT-4o-mini 的完全开放模型,性能接近 Qwen-2.5-72B 等更大规模模型。 模型采用高效的训练策略,通过预训练、中训练和后训练…- 1

- 0

-

Verifier Engineering – 中科院、阿里、小红书联合推出的新型后训练范式

Verifier Engineering项目简介 Verifier Engineering(验证器工程)是中国科学院、阿里巴巴和小红书联合推出的新型后训练范式,为基础模型设计,解决提供有效监督信号的挑战。Verifier Engineering基于自动化验证器执行验证任务并向基础模型提供反馈,分为搜索、验证和反馈三个阶段,优化模型性能。基于闭环反馈机制,强化模型的泛化能力,是实现人工通用智能的重要…- 0

- 0

-

UniPortrait – 阿里推出的AI人像图像个性化编辑工具

UniPortrait项目简介 UniPortrait是阿里巴巴推出的AI图像个性化编辑工具,能将照片转换为动漫风格,支持多人合照和换脸技术。UniPortrait通过先进的”ID嵌入”和”ID路由”技术,在多人合照中也能准确识别和修改每个人的面部特征,避免混淆。UniPortrait不仅能够改变照片风格,还能调整人物的年龄、表情等特征,提供多样化的图像定制服务。 UniPortrait优势介绍 …- 0

- 0

-

MME-CoT – 港中文等机构推出评估视觉推理能力的基准框架

MME-CoT 项目简介 MME-CoT 是香港中文大学(深圳)、香港中文大学、字节跳动、南京大学、上海人工智能实验室、宾夕法尼亚大学、清华大学等机构共同推出的用于评估大型多模态模型(LMMs)链式思维(Chain-of-Thought, CoT)推理能力的基准测试框架,涵盖数学、科学、OCR、逻辑、时空和一般场景等六个领域,包含1,130个问题,每个问题都标注了关键推理步骤和参考图像描述。MME…- 0

- 0

-

Step-Audio – 阶跃星辰开源的语音交互模型

Step-Audio项目简介 Step-Audio是阶跃星辰团队推出的首个产品级的开源语音交互模型,能根据不同的场景需求生成情绪、方言、语种、歌声和个性化风格的表达,能和用户自然地进行高质量对话。Step-Audio基于130B参数的统一模型,将语音理解与生成相结合,支持语音识别、对话、语音合成等功能。Step-Audio 的核心优势包括:高效的语音数据生成引擎、支持多种情感和方言的精细语音控制能…- 1

- 0

-

LBM – AI图像转换框架,实现可控阴影生成

LBM项目简介 LBM(Latent Bridge Matching)是Jasper Research团队推出的新型图像到图像转换框架,基于在潜在空间中构建桥匹配实现快速高效的图像转换。LBM仅需单步推理完成任务,适用多种图像转换场景,如目标移除、重打光、深度和法线估计等。LBM用布朗桥在源图像和目标图像之间建立随机路径,增加样本多样性。条件框架能实现可控的阴影生成和图像重光照。LBM在多项任务中…- 7

- 0

-

Filmfotos – 模拟和还原胶片质感效果的LoRA模型

Filmfotos项目简介 Filmfotos是由DynamicWang推出的的基于Flux架构的LoRA模型,专注于模拟和还原胶片的质感效果。以低饱和度的日系胶片风格为特点,为照片带来柔和、细腻的复古美感。Filmfotos适用于多种场景,包括人物、风景、静物、食物和动物等,在多种图像类型中表现出胶片特有的质感。基于Flux架构的强大性能和LoRA模型的灵活性,提供高精度的图像生成,适合追求胶片…- 3

- 0

-

MedReason – 美国加州联合南洋理工等机构推出的医学推理框架

MedReason项目简介 MedReason是美国加州大学圣克鲁斯分校、加拿大不列颠哥伦比亚大学、新加坡南洋理工大学等机构推出的医学推理框架,基于知识图谱提升大型语言模型(LLMs)在医学领域的推理能力。其中最佳模型MedReason-8B达到最先进的性能。MedReason将临床问答对转换为逻辑推理链(“思考路径”),确保每一步推理都有可靠的医学知识支撑。MedReason数据集包含32,68…- 3

- 0

-

MMBench-Video – 上海AI Lab联合多所高校推出的长视频理解基准测试

MMBench-Video项目简介 MMBench-Video是新颖的长视频多题问答基准测试,是浙江大学、上海人工智能实验室、上海交通大学和香港中文大学联合推出的。MMBench-Video能全面评估大型视觉语言模型(LVLMs)在视频理解方面的能力,用包含丰富视频内容和细粒度能力评估的长视频,弥补现有基准测试在时序理解和复杂任务处理方面的不足。MMBench-Video包含约600个YouTub…- 2

- 0

-

Open Avatar Chat – 阿里开源的实时数字人对话系统

Open Avatar Chat项目简介 Open Avatar Chat 是阿里开源的模块化的实时数字人对话系统,支持在单台电脑上运行完整的功能。Open Avatar Chat 支持低延迟的实时对话(平均响应延迟约2.2秒),兼容多模态语言模型,包括文本、音频和视频等多种交互方式。系统基于模块化设计,用户根据需求灵活替换组件,实现不同的功能组合。Open Avatar Chat 为开发者和研究…- 2

- 0

-

QVQ – 阿里通义开源的视觉推理模型

QVQ项目简介 QVQ是阿里基于Qwen2-VL-72B构建的开源多模态推理模型,结合视觉理解和复杂问题解决能力,提升人工智能的认知能力。QVQ在视觉推理任务中展现出增强的能力,尤其在需要复杂分析思维的领域表现出色。QVQ在MMMU评测中取得了70.3的高分,在各项数学相关基准测试中相比Qwen2-VL-72B-Instruct 有显著提升。QVQ致力实现全能和智能的模型,能深度思考和推理,应对复…- 4

- 0

-

Falcon Mamba 7B – 首个通用Mamba开源AI大模型

Falcon Mamba 7B项目简介 Falcon Mamba 7B是阿联酋技术创新研究所(TII)推出的开源AI大模型,性能超越了Meta的Llama 3.1-8B等模型。Falcon Mamba 7B采用编码器-解码器结构和多头注意力技术,优化了长序列处理能力。训练效率高,能在单个A10 24GB GPU上运行,使用了约5500GT的精选数据集,训练中采用了恒定学习率和学习率衰减策略。 Fa…- 3

- 0

-

Phi-4-Multimodal – 微软最新推出的多模态语言模型

Phi-4-Multimodal项目简介 Phi-4-Multimodal 是微软最新推出的多模态语言模型,拥有 56 亿参数,能将语音、视觉和文本处理集成到一个统一架构中。模型在多个基准测试中表现优异,在自动语音识别(ASR)和语音翻译(ST)任务中,以 6.14% 的单词错误率位居 Hugging Face OpenASR 排行榜首位,超越了 WhisperV3 和 SeamlessM4T-v…- 3

- 0

-

Oasis – Decart联合Etched推出首款AI实时生成的游戏系统

Oasis项目简介 Oasis是世界上首款AI实时生成的游戏,由Decart和Etched联合推出。游戏能以每秒20帧的速度实时渲染交互式视频内容,无需游戏引擎,通过AI模型直接生成。玩家可以自由移动、跳跃、拾取物品,体验由AI实时塑造的游戏世界。Oasis基于Transformer架构,结合ViT和DiT技术,实现了低延迟的实时互动。代码和模型权重已开源,推动社区贡献和技术创新。Oasis的出现…- 4

- 0

-

LeRobot – HuggingFace推出的开源AI聊天机器人项目

LeRobot项目简介 LeRobot是由HuggingFace推出的开源AI聊天机器人项目,由前特斯拉研究员Remi Cadene领导开发。LeRobot致力于降低机器人技术的入门门槛,提供预训练模型、数据集和模拟环境,支持模仿学习和强化学习。LeRobot旨在创建一个多功能、可扩展的AI系统,适用于各种机器人硬件,从简单机械臂到复杂人形机器人。 LeRobot优势介绍 预训练模型:提供大量预训…- 2

- 0

-

Fin-R1 – 上海财经联合财跃星辰推出的金融推理大模型

Fin-R1项目简介 Fin-R1是上海财经大学联合财跃星辰推出的首个金融领域R1类推理大模型。基于7B参数的Qwen2.5-7B-Instruct架构,通过在金融推理场景的高质量思维链数据上进行SFT和RL两阶段训练,有效提升金融复杂推理能力。在权威评测中,Fin-R1平均得分75.2分,与行业标杆DeepSeek-R1仅差3分,位居榜单第二。数据构建融合了多个金融领域的高质量数据集,通过数据蒸…- 3

- 0

-

TimesFM 2.0 – 谷歌研究团队开源的时间序列预测模型

TimesFM 2.0项目简介 TimesFM 2.0是谷歌研究团队推出的开源时间序列预测模型。具备强大的预测能力,可处理长达2048个时间点的单变量时间序列,支持任意预测时间跨度。模型采用仅解码器架构,结合输入修补和修补掩码技术,实现高效训练与推理,支持零样本预测。预训练数据集丰富,涵盖多个领域,使模型具有良好的泛化能力。TimesFM 2.0可用于零售销量预测、金融市场走势分析等常见场景,能在…- 2

- 0

-

Embodied Reasoner – 浙大联合阿里等机构推出的具身交互推理模型

Embodied Reasoner项目简介 Embodied Reasoner是浙江大学、中国科学院软件研究所、阿里巴巴集团等机构推出的新型的具身交互推理模型,基于视觉搜索、推理和行动协同完成复杂任务。模型基于模仿学习、自我探索和自我修正的三阶段训练方法,生成多样化的思考过程(如情境分析、空间推理、自我反思等),基于交互历史和空间布局进行高效规划和推理。在AI2-THOR模拟器的多种任务中,Emb…- 2

- 0