-

ChopperBot – AI直播视频剪辑和发布机器人,自动化管理直播内容

ChopperBot项目简介 ChopperBot是一款智能化的直播视频剪辑和发布机器人,ChopperBot能自动化地管理和分发直播内容。支持多个流行直播平台,如斗鱼、虎牙、B站、抖音和Twitch等,ChopperBot能自动爬取直播视频、智能切片、生成封面和标题,上传内容。ChopperBot具备热门内容分析功能,紧跟流行趋势,为用户推荐热门直播内容。ChopperBot的模块化设计具有高度…- 208

-

MMaDA – 字节联合普林斯顿大学等推出的多模态扩散模型

MMaDA项目简介 MMaDA(Multimodal Large Diffusion Language Models)是普林斯顿大学、清华大学、北京大学和字节跳动推出的多模态扩散模型,支持跨文本推理、多模态理解和文本到图像生成等多个领域实现卓越性能。模型用统一的扩散架构,具备模态不可知的设计,消除对特定模态组件的需求,引入混合长链推理(CoT)微调策略,统一跨模态的CoT格式,推出UniGRPO,…- 182

-

AniTalker – 上海交大开源的对口型说话视频生成框架

AniTalker项目简介 AniTalker是由来自上海交大X-LANCE实验室和思必驰AISpeech的研究人员推出的AI对口型说话视频生成框架,能够将单张静态人像和输入的音频转换成栩栩如生的动画对话视频。该框架通过自监督学习策略捕捉面部的复杂动态,包括微妙的表情和头部动作。AniTalker利用通用运动表示和身份解耦技术,减少了对标记数据的依赖,同时结合扩散模型和方差适配器,生成多样化和可控…- 181

-

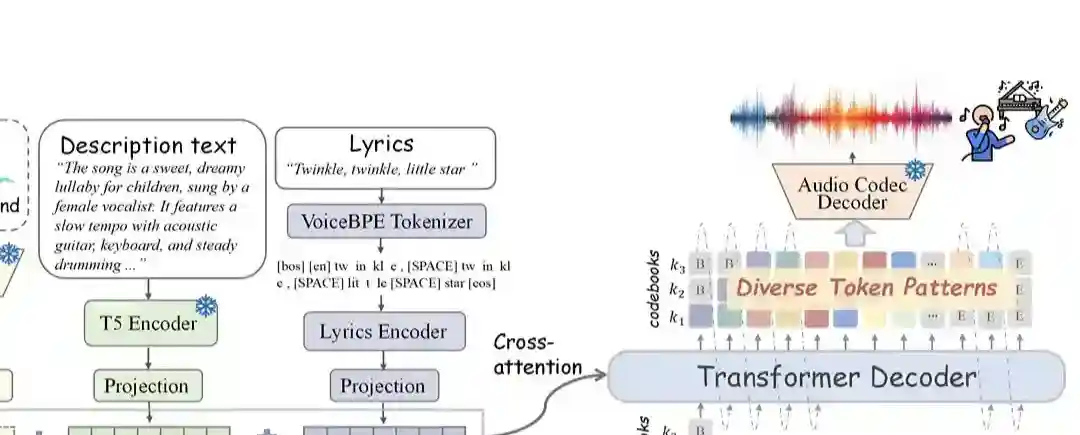

SongGen – 上海 AI Lab 和北航、港中文推出的歌曲生成模型

SongGen项目简介 SongGen是上海AI Lab、北京航空航天大学和香港中文大学推出的单阶段自回归Transformer模型,用在从文本生成歌曲。SongGen基于歌词和描述性文本(如乐器、风格、情感等)作为输入,支持混合模式和双轨模式两种输出方式,分别用于直接生成人声与伴奏的混合音频,及分别合成人声和伴奏方便后期编辑。SongGen基于创新的音频标记化策略和训练方法,显著提升生成歌曲的自…- 155

-

ReCamMaster – 浙大联合快手等推出的视频重渲染框架

ReCamMaster项目简介 ReCamMaster 是浙江大学、快手科技等联合推出的视频重渲染框架,能根据新的相机轨迹重新生成视频内容。通过预训练模型和帧维度条件机制,结合多相机同步数据集和相机姿态条件,实现视频视角、运动轨迹的灵活调整。用户可上传视频并指定轨迹,系统会生成新的视角视频,广泛应用于视频创作、后期制作、教育等领域,为视频内容带来全新视角和动态效果,提升创作自由度和质量。 ReCa…- 149

-

YuE – 港科大联合 M-A-P 推出的开源AI音乐生成模型

YuE项目简介 YuE 是香港科技大学和 Multimodal Art Projection 团队联合开发的开源 AI 音乐生成模型。能将歌词转化为完整的歌曲,支持多种音乐风格,包括流行、金属、爵士、嘻哈等,并且支持英语、中文、日语和韩语等多种语言。YuE 通过语义增强音频分词器、双分词技术、歌词链式思维生成和三阶段训练方案,解决了音乐生成中的长上下文、复杂音乐信号、语言内容失真等挑战,生成的歌曲…- 90

-

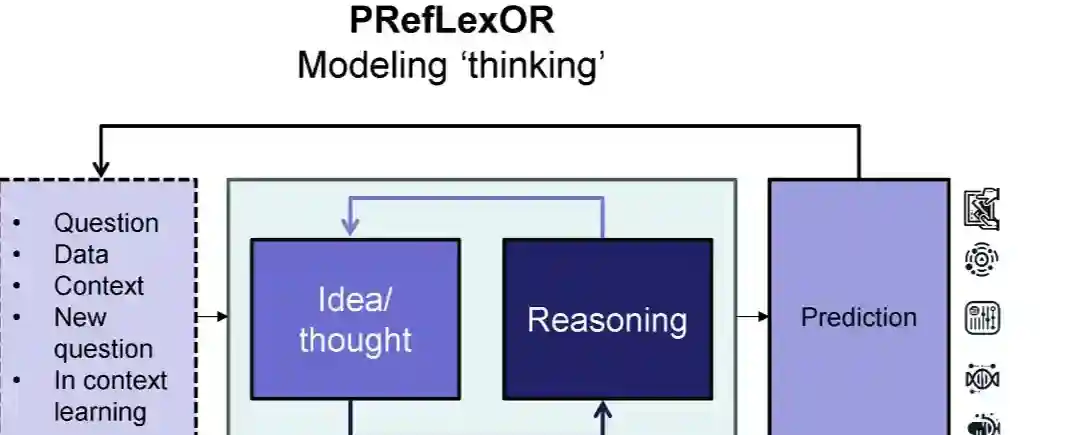

PRefLexOR – MIT 团队推出的新型自学习AI框架

PRefLexOR项目简介 PRefLexOR(Preference-based Recursive Language Modeling for Exploratory Optimization of Reasoning)是MIT团队提出的新型自学习AI框架,结合了偏好优化和强化学习(RL)的概念,模型能通过迭代推理改进自我学习。框架的核心是递归推理算法,模型在训练和推理阶段会进行多步推理、回顾和…- 81

-

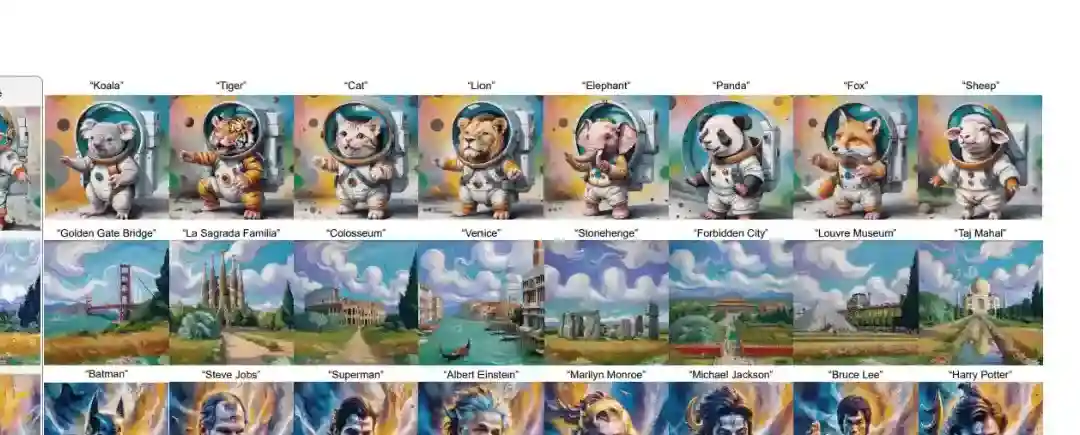

ArtCrafter – 清华联合鹏城实验室和联想共同推出的文本到图像风格迁移框架

ArtCrafter项目简介 ArtCrafter是清华大学、鹏城实验室和联想研究院共同推出的文本到图像风格迁移框架,基于扩散模型,解决传统方法在风格表达、内容一致性和输出多样性方面的局限。ArtCrafter基于嵌入重构架构实现,包含三个关键组件:基于注意力的风格提取模块,用多层架构和感知器注意力机制从参考图像中提取细腻的风格特征;文本-图像对齐增强模块,基于注意力交互将图像和文本嵌入映射到共享…- 42