-

MobileLLM – Meta推出的适合移动端的语言模型

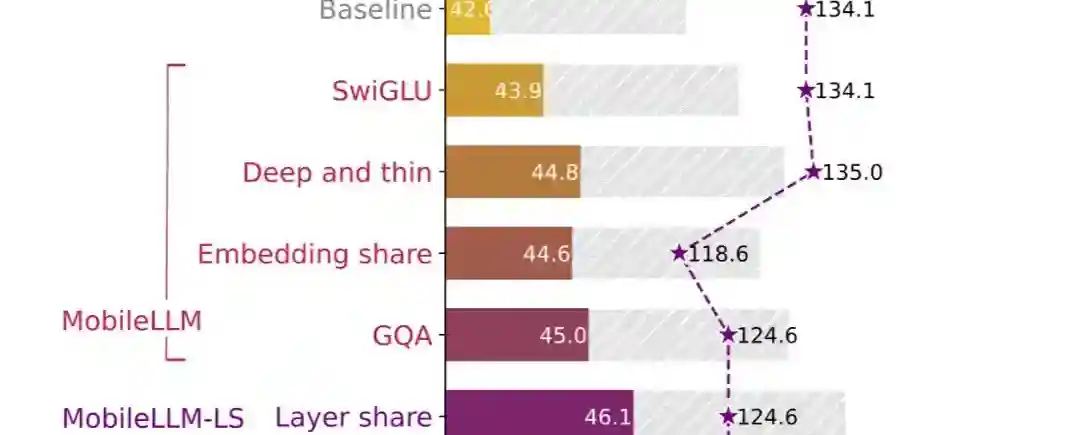

MobileLLM项目简介 MobileLLM是Meta为移动设备用例优化设计的十亿参数以下的大型语言模型,能解决云成本上升和延迟问题。MobileLLM基于深薄架构、嵌入共享和分组查询注意力机制等设计,实现在参数少于十亿的情况下获得高质量的语言模型。MobileLLM-125M/350M在零样本常识推理任务上相比先前的模型显著提升准确率,且MobileLLM家族在聊天基准测试中显示出对小型模型的…- 1

-

MEXMA – Meta推出的预训练跨语言句子编码器

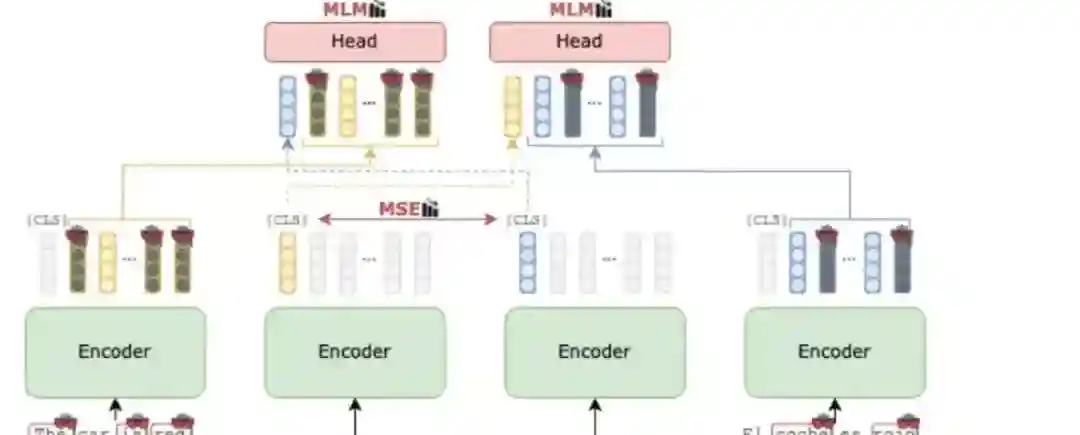

MEXMA项目简介 MEXMA是由Meta AI推出的一种新型的预训练跨语言句子编码器。基于结合句子级和词语级的目标提升句子表示的质量。在训练过程中,MEXMA用一种语言的句子表示预测另一种语言中被遮蔽的词语,支持直接更新编码器中的句子表示和所有词语。MEXMA在多个任务上展现优越的性能,超越现有的预训练跨语言句子编码器,如LaBSE和SONAR。MEXMA支持80种语言,在句子分类等下游任务中表…- 2

-

WorldMem – 南洋理工联合北大和上海 AI Lab 推出的世界生成模型

WorldMem项目简介 WorldMem 是南洋理工大学、北京大学和上海 AI Lab 推出的创新 AI 世界生成模型。模型基于引入记忆机制,解决传统世界生成模型在长时序下缺乏一致性的关键问题。在WorldMem中,智能体在多样化场景中自由探索,生成的世界在视角和位置变化后能保持几何一致性。WorldMem 支持时间一致性建模,模拟动态变化(如物体对环境的影响)。模型在 Minecraft 数据…- 1

-

HMA – MIT联合Meta等推出的机器人动作视频动态建模方法

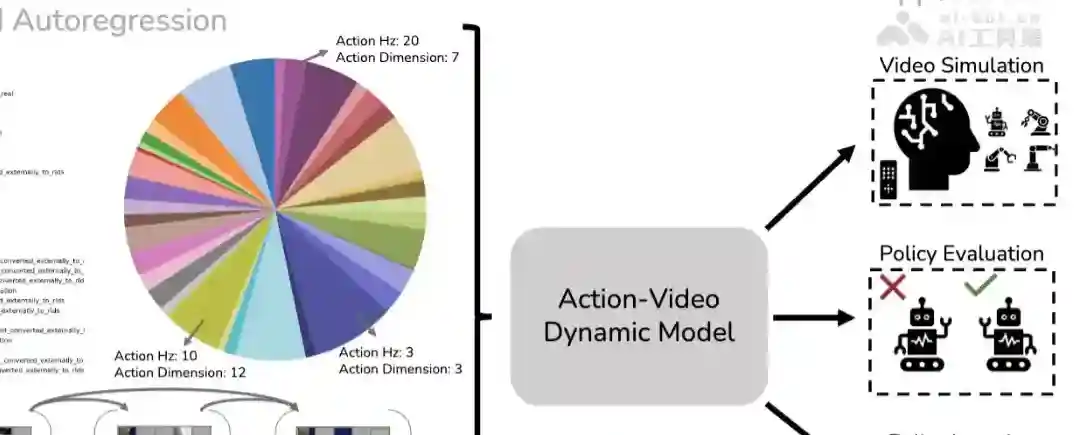

HMA项目简介 HMA(Heterogeneous Masked Autoregression)是麻省理工学院、Meta和伊利诺伊大学香槟分校开源的,用在建模机器人动作视频动态的方法。HMA基于异构预训练,用不同机器人实体、领域和任务中的观测和动作序列,结合掩码自回归技术生成视频预测。HMA支持离散和连续两种变体,分别用在快速生成和高保真度生成,处理动作空间的异构性,包括不同的动作频率、维度和动作…- 1

-

Voice Engine – OpenAI公布的AI语音合成和声音克隆模型

Voice Engine项目简介 Voice Engine是OpenAI最新公布的一项AI语音合成和声音克隆技术,能够利用简短的15秒音频样本和文本输入,生成接近原声的自然听起来的语音。该项技术自2022年底开发以来,已经被应用于OpenAI的文本到语音API和ChatGPT的语音功能中。Voice Engine的应用前景广泛,包括为儿童和非读者提供阅读辅助、翻译内容以触及全球听众、支持非言语交流…- 2

-

Veo – 谷歌推出的可生成1分钟1080P的视频模型

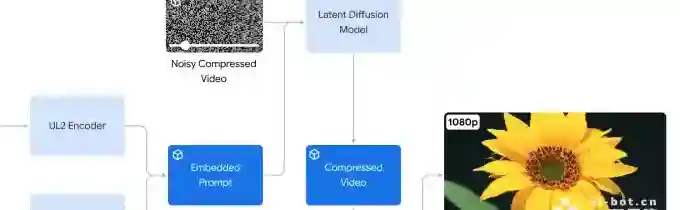

Veo项目简介 Veo是由Google DeepMind开发的一款视频生成模型,用户可以通过文本、图像或视频提示来指导其生成所需的视频内容,能够生成时长超过一分钟1080P分辨率的高质量视频。Veo拥有对自然语言的深入理解,能够准确捕捉和执行各种电影制作术语和效果,如延时摄影或航拍镜头。Veo生成的视频不仅在视觉上更加连贯一致,而且在人物、动物和物体的动作表现上也更加逼真。Veo的开发旨在使视频制…- 0

-

CodeDPO – 北京大学联合字节共同推出的代码生成优化框架

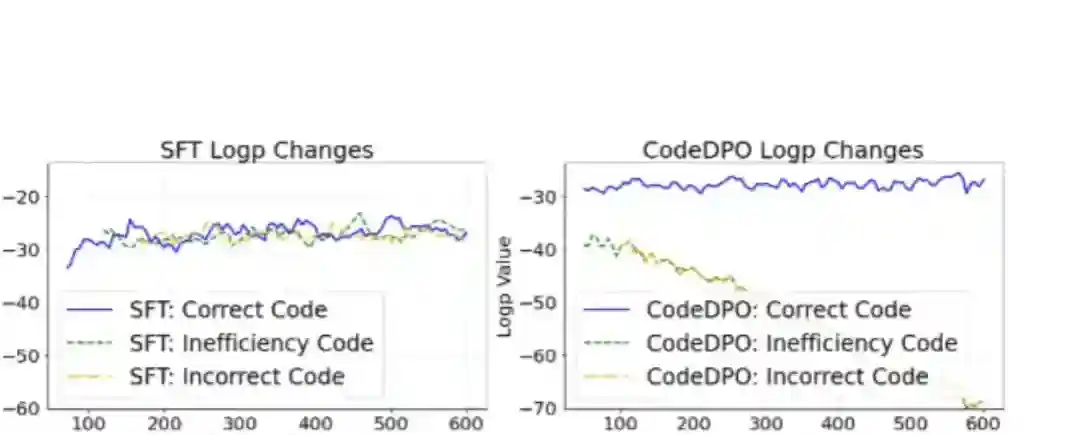

CodeDPO项目简介 CodeDPO是北京大学与字节跳动合作推出的代码生成优化框架,能提升代码模型在正确性和效率方面的表现。框架基于自生成和验证机制,同时构建和评估代码及其测试用例,用PageRank算法迭代更新代码片段的排名,最终形成基于正确性和效率优化的数据集。CodeDPO不依赖外部资源,能够灵活、可扩展地生成多样化的偏好优化数据,为复杂现实场景中的代码模型优化提供了坚实基础。 CodeD…- 0

-

Apollo – Meta 联合斯坦福大学推出的大型多模态模型

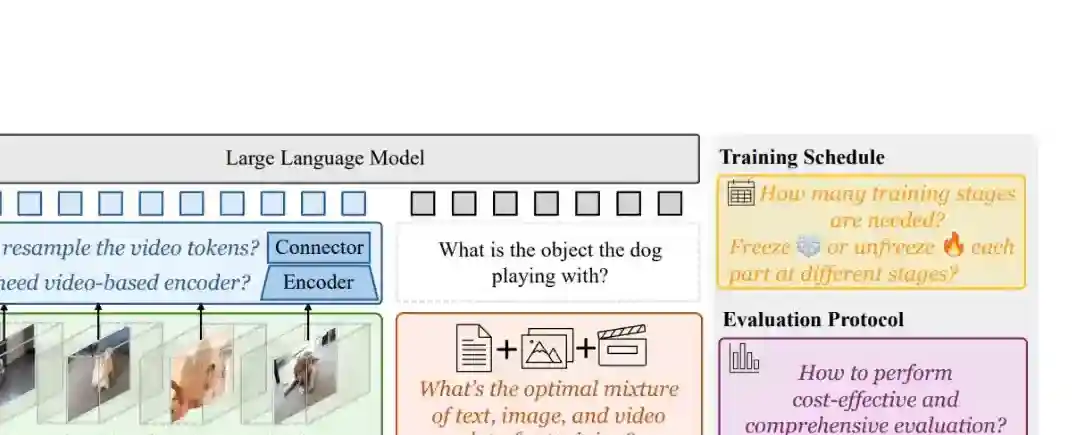

Apollo项目简介 Apollo是Meta和斯坦福大学合作推出的大型多模态模型(LMMs),专注于视频理解。Apollo基于系统研究,揭示视频理解在LMMs中的关键驱动因素,推出“Scaling Consistency”现象,即在较小模型上的设计决策能有效扩展至大型模型。Apollo项目引入ApolloBench,一个高效的视频理解评估基准,及一系列先进的Apollo模型,这些模型在不同规模上均…- 1