-

Midjourney角色一致性命令 "cref "测评如何保持多个角色一致性

预告了好久的MJ角色一致性功能终于来了, 新的命令“ --cref ”与 样式参考 “--sref”功能类似,但它不是匹配参考样式,而是尝试让角色匹配 "角色参考 "图像,--cref 目前只适用于 niji 6 和 v6 模型。 官方文档说明看下图: 在提示后输入 --cref URL 并输入字符图像的 URL网址,再使用--c…- 2

-

Parakeet TDT 0.6B – 英伟达开源的自动语音识别模型

Parakeet TDT 0.6B项目简介 Parakeet TDT 0.6B 是英伟达推出的开源自动语音识别(ASR)模型。采用FastConformer编码器和TDT解码器架构,通过预测文本标记及其持续时间加速推理,减少计算开销。模型在1秒内可转录60分钟音频,实时因子(RTFx)达3386,平均单词错误率(WER)仅为6.05%,在LibriSpeech-clean数据集上WER低至1.69…- 1

-

Evolving Agents – 开源的AI Agent管理与进化框架

Evolving Agents项目简介 Evolving Agents 是用在创建、管理和进化 AI 代理的生产级框架。Evolving Agents支持智能代理之间的通信和协作,根据语义理解需求、基于过往经验进化,有效解决复杂任务。框架具备智能代理进化、代理间通信等核心功能。Evolving Agents 适用于文档处理、医疗保健、金融分析、客户服务等多领域场景,旨在通过智能代理的协同工作提升任…- 0

-

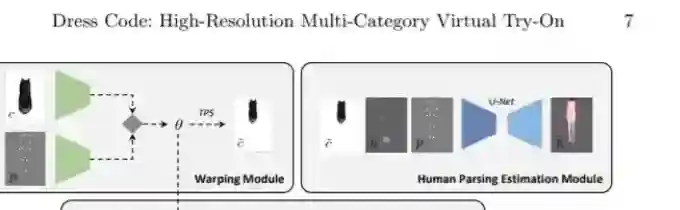

DressCode – 上海科技大学推出的3D服装生成框架

DressCode项目简介 DressCode是上海科技大学、宾夕法尼亚大学和Deemos科技联合推出的3D服装生成框架。支持用户通过文本描述来自动生成各种风格和材质的3D服装模型。基于SewingGPT核心模块,DressCode能理解文本提示并转化为精细的裁剪图案,再结合物理基础的渲染技术,创造出逼真的服装效果。 DressCode优势介绍 文本驱动的服装生成:用户输入文本描述,系统自动生成相…- 0

-

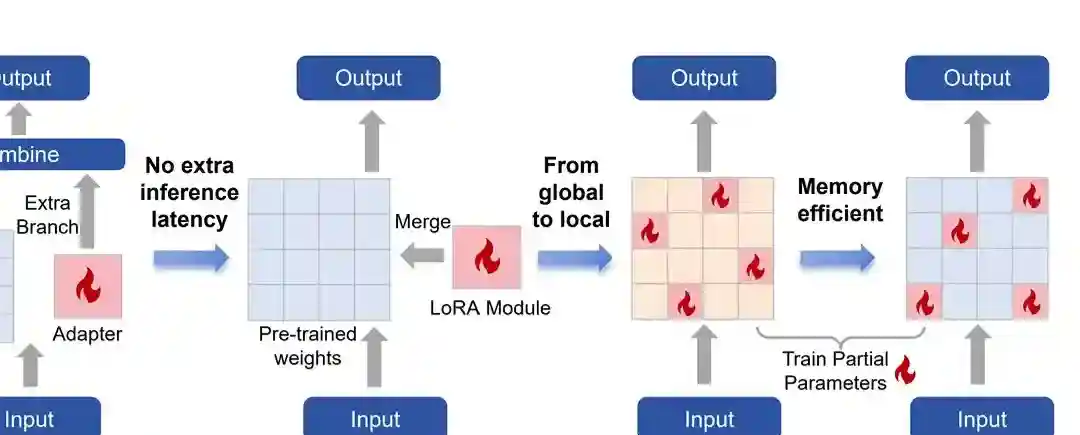

SaRA – 上海交大联合腾讯推出的预训练扩散模型微调方法

SaRA项目简介 SaRA是一种新型的预训练扩散模型微调方法,由上海交通大学和腾讯优图实验室共同推出。基于重新激活预训练过程中看似无效的参数,让模型能适应新任务。SaRA基于核范数低秩稀疏训练方案避免过拟合,引入渐进式参数调整策略,优化模型性能。SaRA能提高模型的适应性和泛化能力,显著降低计算成本,只要修改一行代码即可实现,具有很高的实用价值。 SaRA优势介绍 参数重新利用:激活在预训练中未被…- 1

-

LVCD – 腾讯联合香港城市大学推出为动漫视频线稿上色的AI框架

LVCD项目简介 LVCD(Large Video Color Diffusion)是一个专为动画视频线稿上色设计的视频扩散框架,能将黑白线稿自动转化为彩色动画视频。LVCD使用了一种先进的扩散模型,可以同时处理整个视频序列,保证每一帧的颜色连贯,在角色快速移动时,也能保持颜色一致。LVCD提出了参考注意力机制,能有效地将参考帧的色彩转移到其他帧,在快速和大范围运动的场景中。LVCD支持生成长时间…- 0

-

DanceGRPO – 字节Seed联合港大推出的统一视觉生成强化学习框架

DanceGRPO项目简介 DanceGRPO 是字节跳动 Seed 和香港大学联合推出的首个统一视觉生成强化学习框架。将强化学习应用在视觉生成领域,覆盖两大生成范式(diffusion 和 rectified flow)、三项任务(文本到图像、文本到视频、图像到视频)、四种基础模型(SD、HunyuanVideo、FLUX、SkyReels-I2V)及五类奖励模型(图像视频美学、图文对齐、视频动…- 0

-

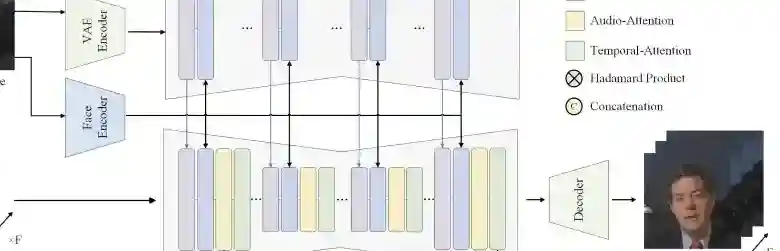

Hallo – 复旦百度等开源的AI对口型肖像视频生成框架

Hallo项目简介 Hallo是由复旦大学、百度公司、苏黎世联邦理工学院和南京大学的研究人员共同提出的一个AI对口型肖像图像动画技术,可基于语音音频输入来驱动生成逼真且动态的肖像图像视频。该框架采用了基于扩散的生成模型和分层音频驱动视觉合成模块,提高了音频与视觉输出之间的同步精度。Hallo的网络架构整合了UNet去噪器、时间对齐技术和参考网络,以增强动画的质量和真实感,不仅提升了图像和视频的质量…- 0